Objektive Hohe Schule des Sehens

Die Auswahl der passenden Optik ist für Sie kein Problem das ist simples Schulwissen? Hand aufs Herz: Gelingt Ihnen mühelos die Berechnung der Brennweite, der Tiefenschärfe? Wenn ja, dann dürfen Sie sich zu den Ausnahmen zählen. Für alle anderen ist dieser Beitrag als Hilfe gedacht, denn die Auswahl ist keineswegs trivial und erfordert fundierte Kenntnisse.

Anbieter zum Thema

Jeder Hersteller hochwertiger, optischer Lösungen für Bildverarbeitungsapplikationen sieht sich immer wieder aufs neue mit der Situation konfrontiert, dass bei vielen Systemintegratoren eine wichtige Komponente (die nicht zuletzt die Leistung der gesamten Anwendung entscheidet) bei der Systemzusammenstellung oft erst als eine der letzten Komponenten in Betracht gezogen wird: die Wahl einer geeigneten Optik. Als Ursache dafür ist zu vermuten, dass die Komplexität dieser Komponenten sowie die Begrenzung durch physikalische Randbedingungen und Grenzen, die letztlich die entsprechende Auswahl beeinflussen und beschränken, häufig unterschätzt werden.

Aus Anwendersicht sind typische Auswahlkriterien die darzustellende Objektgröße in Verbindung mit der Größe der kleinsten, noch aufzulösenden Strukturen, der geplante Arbeitsabstand sowie häufig die notwendige Schärfentiefe. Meist steht bei Stellung dieser Fragen bereits die Wahl der Kamera, des Beleuchtungssystems und mechanischer Randbedingungen fest. Das Bestreben des Applikationsingenieurs ist darum meist darauf ausgerichtet, in dieses vorgegebene Korsett eine geeignete Optik einpassen zu müssen.

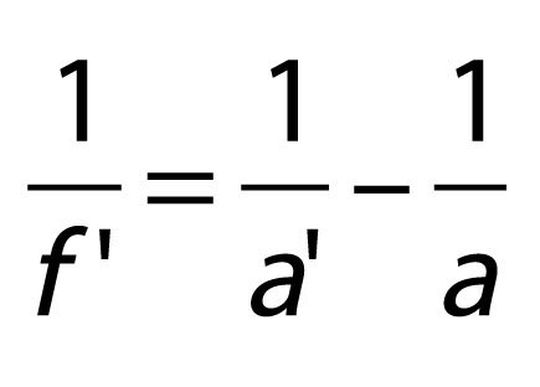

Abschätzung der Brennweite: Anhand der obigen, aus der Applikation bestimmbaren Rahmendaten lässt sich anhand einfacher geometrischer Beziehungen zunächst eine geeignete Brennweite überschlägig bestimmen. Hierbei kann die für eine solche Überschlagsrechnung auch bei komplexeren Objektiven ansatzweise gültige Linsengleichung für dünne Linsen zur Anwendung kommen (Formel1) wobei a und a’ als Objekt- bzw. Bildweiten bezeichnet werden und die Abstände von den optischen Hauptebenen angeben. Für eine überschlägige Abschätzung kann man nun die Objektweite a mit dem jeweiligen Arbeitsabstand gleichsetzen.

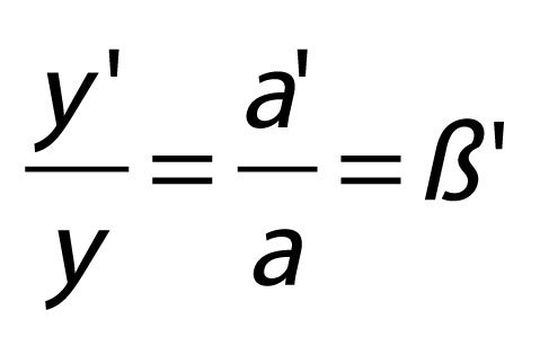

Desweiteren gilt aufgrund des Strahlensatzes zwischen Objekt- und Bildweite und Objekt- und Bildgröße die Beziehung (Formel 2) wobei β’ auch als Abbildungsmaßstab bezeichnet wird.

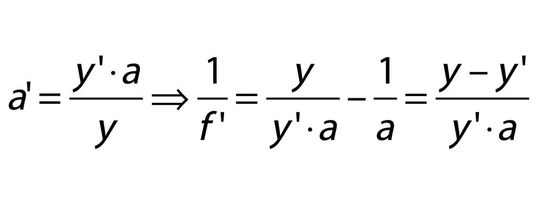

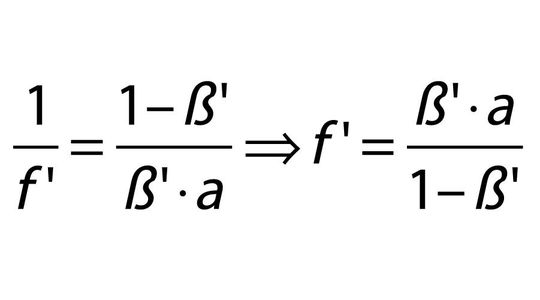

Anmerkung: Gemäß DIN 1335 wird die Objektebene in zweidimensionalen Darstellungen typischerweise auf der linken Seite der Optik angenommen. Entsprechende Strecken im Objektraum sind entsprechend mit negativen Vorzeichen zu versehen. Daraus ergibt sich folglich, dass z.B. β’ ebenfalls negativ sein muss. Entsprechend lässt sich aus oben angeführter Formel folgern:

bzw. unter Verwendung von y' = β' • y ist

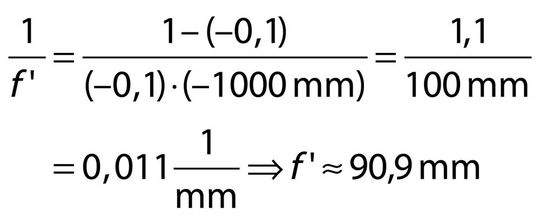

Wollen wir, als Beispiel, ein Objekt von 100 mm Durchmesser auf einen Sensor mit 10 mm Durchmesser abbilden, und soll das Objekt einen Abstand von 1 m haben, so ergäbe sich daraus:

und somit also eine Brennweite von etwa 91 mm.

Es sei nochmals warnend darauf hingewiesen, dass diese, eigentlich nur für dünne Linsen gültige Formel nur als erste Näherung verstanden werden darf.

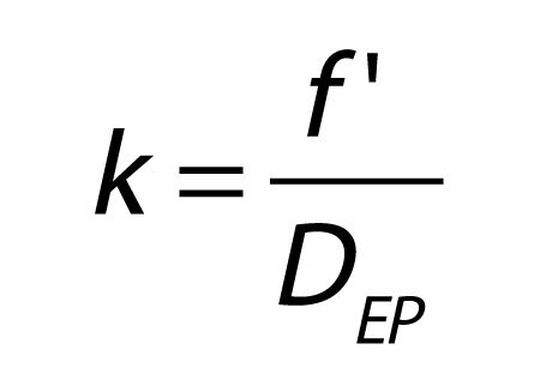

Die Bedeutung der Blendenzahl: Wie aus Bild 1 ersichtlich, wird der Öffnungswinkel u‘ eines vom Achsenpunkt des Objekts ausgehenden Strahlenbündels durch Lage und Größe der Eintrittspupille EP und die Systembrennweite f’ bestimmt. Die insbesondere bei Fotoobjektiven und Fernrohren gebräuchliche Blendenzahl k ist definiert als das Verhältnis von Brennweite zum Durchmesser der Eintrittspupille DEP.

Mit abnehmendem Öffnungswinkel nimmt k entsprechend zu. Der Kehrwert 1/k wird als Öffnungsverhältnis bezeichnet. Die Blendenzahl k steht zudem in direktem Bezug zur sogenannten numerischen Apertur NA’, die wiederum definiert ist als NA‘ ≡ n‘ sin (u‘) wobei der Brechungsindex n’ für typische Objektive zu 1 (Luft) angenommen werden kann.

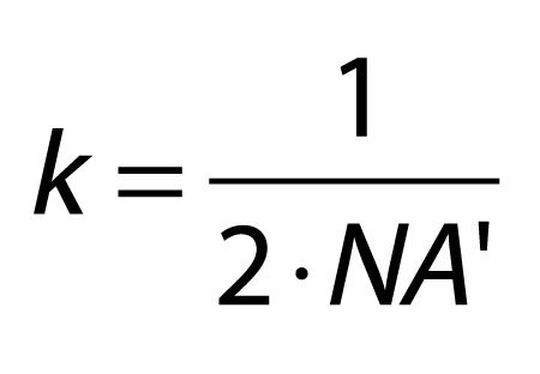

Für die in Bild 1 dargestellte Abbildung aus dem Unendlichen gilt weiterhin zwischen k und NA’

Wie geometrisch direkt ersichtlich, ist die numerische Apertur proportional zum Durchmesser des bildseitigen Strahlenbündels und somit das Quadrat der numerischen Apertur proportional zur resultierenden, bildseitigen Bestrahlungsstärke in der Abbildungsebene: Ee ∼ (NA‘)2.

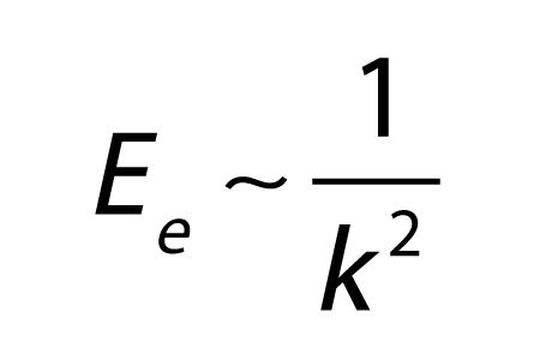

Für die Annahme einer Fokusierung auf Unendlich gilt aufgrund des oben angeführte Bezugs zwischen NA’ und k für die Abbildung aus Unendlich ein entsprechender Bezug zwischen k und der resultierenden Bestrahlungsstärke

Üblicherweise werden deshalb insbesondere bei einstellbarer Blende Blendenzahlen derart gestuft, dass die relative Bestrahlungsstärke sich zwischen zwei Stufen jeweils um den Faktor 2 ändert, wodurch aufeinander folgende Blendenzahlen k selbst im Verhältnis 1/√2 stehen: (k = 1,0; 1,4; 2,0; 2,8; 4,0; 5,6 … => k2 = 1, 2, 4, 16, 32 …, (1/k)2 = 1; 0,5; 0,25; 0,125; …).

Für technische Anwendungen ist die Annahme einer Fokusierung auf Unendlich in vielen Fällen nicht mehr gegeben. Aus diesem Grunde ist anzuraten, die Auswahl eines geeigneten Objektivs nicht an der maximalen Blendenzahl zu orientieren, sondern dazu die jeweilige numerische Apertur heranzuziehen.

Die Grenze des physikalisch Machbaren: Beugungsbegrenzte Abbildung.

Ein System heißt beugungsbegrenzt, wenn es hinsichtlich seiner Abbildungsleistung derart frei von Abbildungsfehlern ist, dass die Begrenzung der optischen Leistung alleine durch den Wellencharakter des Lichts und dadurch resultierende Beugungseffekte am Linsensystem vorgegeben ist. Die sich somit ergebende physikalische Begrenzung ist durch das jeweilige geometrische Design eines optischen Systems bestimmt und stellt grundsätzlich die theoretische Grenze der Abbildungsleistung dar.

Die Beschreibung eines optischen Systems durch Übertragungsfunktionen: Um die Leistung eines optischen Systems zu beschreiben, bedient man sich oftmals richtungs- und ortsabhängiger optischer Übertragungsfunktionen (Optical Transfer Function, OTF), die sich als die Fourier-Transformierte der zu einem optischen System gehörigen Punktbildfunktion ergeben. Die OTF selbst ist eine komplexe Funktion, deren Betrag wiederum die sogenannte Modulationstransferfunktion (MTF) darstellt und die Grenzen lateral noch unterscheidbarer Strukturen charakterisiert.

Insbesondere die Modulationstransferfunktion stellt deshalb eine verbreitete und probate Möglichkeit zur Darstellung der optischen Leistungsgrenzen eines Objektivs in Bezug auf dessen Auflösungsvermögen dar. Die MTF gibt dabei den möglichen Kontrast der Abbildung lateral aufgelöster, periodischer Strukturen in Abhängigkeit von der Größe der Strukturen (typischerweise angegeben in Form von Linienpaaren pro mm) an. Aus einer solchen Darstellung lassen sich unmittelbar die Grenzen des optischen Auflösungsvermögens eines optischen Systems erkennen.

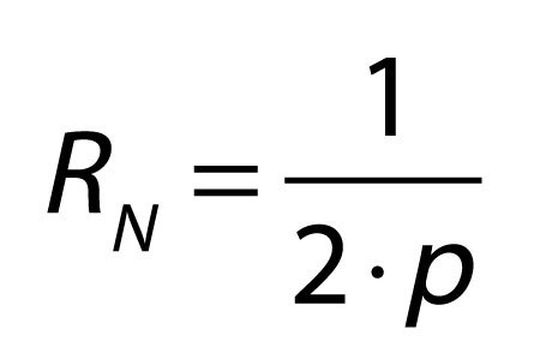

Wie das Testmuster in Bild 2 zeigt, nehmen bei Strukturen mit abnehmendem Abstand zwischen den einzelnen Linien in der Abbildung die Unterschiede zwischen Hell-und Dunkelzonen und damit deren Kontrast kontinuierlich ab. Definiert man somit ein für eine bestimmte Anwendung notwendigen Minimalkontrast, kann man aus dem Graph unmittelbar die kleinsten noch unterscheidbaren Strukturen ersehen. Hierbei ist zu berücksichtigen, dass auf der Bildseite die theoretische Grenze durch die Abstände der Sensorpixel bestimmt ist, wodurch selbst bei einer idealen Optik eine aus dem Abbildungsverhältnis β’ resultierende objektseitige Auflösungsgrenze vorgegeben ist. Die durch den Sensor vorgegebene bildseitige Grenzauflösung RN bestimmt sich zu

Linienpaare/mm, wobei p die Pixelgröße in mm angibt. Daraus folgt unmittelbar die auf der Objektseite theoretisch auflösbare Grenzfrequenz RN • (-β’).

Es sei an dieser Stelle warnend darauf hingewiesen, dass eine absichtliche Überspezifikation der geforderten Abbildungsleistung eines Objektivs ebenfalls negativen Einfluss auf die Leistung des Gesamtsystems haben kann: Da neben der Optik selbst der Kamerasensor aufgrund von Pixelgröße und anderer festliegender Eigenschaften (Füllfaktor, etc.) ein bestimmtes Auflösungsvermögen hat, kann es durch eine leistungsstärker ausgelegte Optik zu Artefakten z.B. in Form von Moiré-Effekten kommen. Diese lassen sich in Folge dann nur durch z.B. absichtliche Defokusierung (und damit inhärenter Reduktion der MTF) kompensieren. Darum ist also auch darauf zu achten, dass die gesamte Kontrastübertragung (aus Objektiv und Bildsensor) bei der maximalen Linienpaarzahl RN genügend klein ist, damit z.B. periodische Strukturen, die kleiner als die Auflösungsgrenze des Sensors sind, nicht mehr übertragen werden und somit keine Moiré-Effekte auftreten.

Andernfalls kann es passieren, dass eine Optik mit hohem Kontrast bei Objekten mit periodischen Strukturen jenseits der Grenz-Linienpaarzahl RN schlechter beurteilt wird als eine weniger gute mit mäßigem Kontrast.

Schärfentiefebereich: Häufig wird man im Rahmen der Auswahl einer geeigneten Optik mit der Forderung eines möglichst großen Schärfentiefebereichs konfrontiert um somit sicherzustellen, dass vordere wie auch hintere Teile eines Objektes ohne Refokusierung eine für die jeweilige Anwendung noch hinreichend scharfe Abbildung erfahren.

Daraus leitet sich die Frage ab, welche Faktoren die Schärfentiefe eines Objektivs beeinflussen und wie sich der Schärfentiefebereich bestimmen lässt: In Einführungsliteratur über optische Grundlagen wird Schärfentiefe häufig aus geometrischer Sicht definiert. In Anlehnung an die Darstellung Pedrotti’s (1) sei hier lediglich diese geometrischen Formel aufgeführt, ohne auf deren Herleitung näher einzugehen.

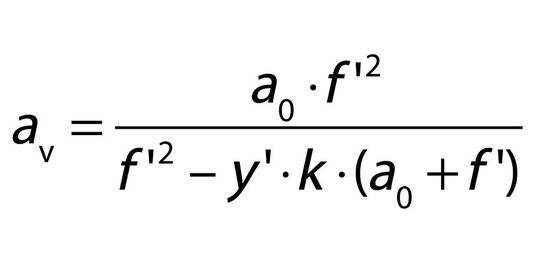

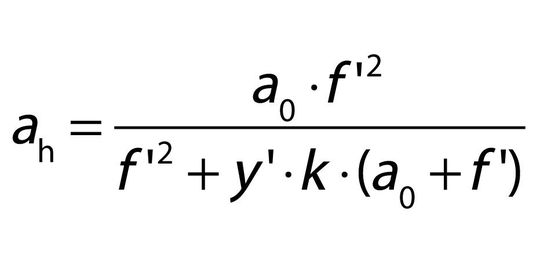

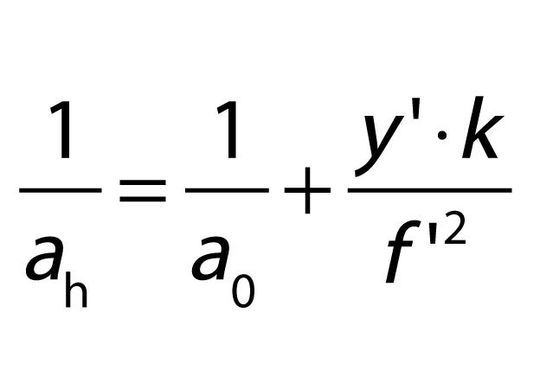

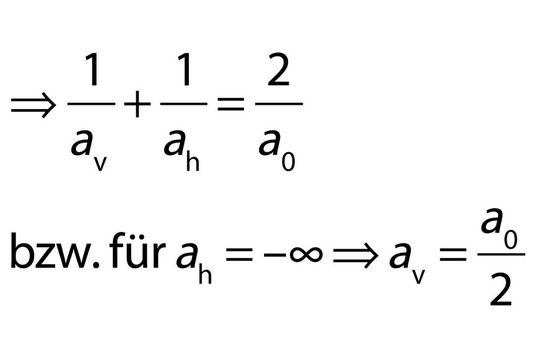

Die Formel bezieht sich auf eine kleinste Struktur y’, die dem zulässigen, bildseitigen Fehlerkreis entspricht und z.B. eine zulässige Verschleifung z.B. über zwei Pixel bedeuten könnte. Der Bereich einer noch scharfen Abbildung wird dabei durch die vom Objektiv in Objektrichtung gemessene vordere und hinteren Grenze av bzw. ah definiert, wobei das Objektiv als auf die dazwischen liegende Entfernung a0 fokusiert angenommen wird.

Es ergibt sich dann für die vordere Grenze

und die hintere Grenze

wobei y’ dem zulässigen, bildseitigen Fehlerkreis entspricht.

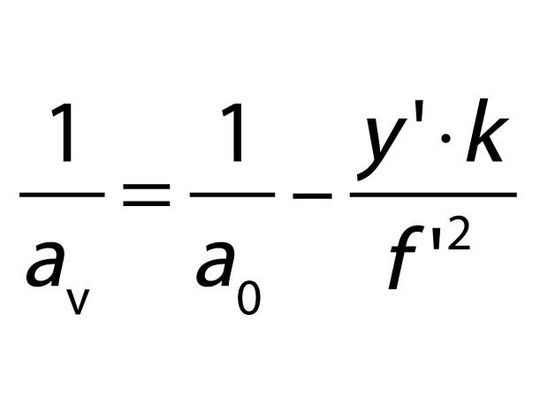

Unter der insbesondere bei fotografischen Anwendungen gültigen Annahme eines im Vergleich zur Brennweite großen Objektabstandes ƒ<<|a0| und der Brennweite annähernd gleicher Bildweite a‘≈ƒ‘ vereinfachen diese Formeln sich weiter:

für die vordere Grenze und

für die hintere Grenze. Das führt zu

Aus diesen Formeln wird unmittelbar ersichtlich, dass der Bereich einer scharfen Abbildung immer sowohl von gewählter Brennweite wie auch der eingestellten Blende abhängt, wobei eine Verkleinerung der Blende (und somit eine Vergrößerung der Blendenzahl k) zu einer Vergrößerung des Schärfetiefenbereichs führt.

In realen Anwendungen hat diese rein geometrische Herleitung eines Schärfetiefebereichs jedoch nur noch eingeschränkte Bedeutung, da eine solche Betrachtung anhand künstlich angenommener Kriterien (hier z.B. in Form des zulässigen Fehlerkreises y’) eine starke Vereinfachung tatsächlicher Verhältnisse darstellt. In Wirklichkeit werden im Abbildungsprozess folgende, die Schärfentiefe beeinflussenden Faktoren simultan wirksam: geometrische Aberrationen des jeweiligen Optikdesigns, Beugungseffekte des Lichts sowie bei visuellen Aufbauten die Akkomodation des Auges.

Aus diesem Grunde wird insbesondere bei Anwendungen im Bereich der Machine Vision der Bereich einer für die Anwendung ausreichenden Schärfentiefe zunehmend in Form sogenannter Through-Focus-MTF-Berechnungen (Bild 3) bestimmt, bei denen Schärfentiefe in Form des Bereichs der noch vorhandenen Modulation für die interessierende Raumfrequenz als Funktion MTF(R) = ƒ(Δz) der Defokusierung dargestellt wird.

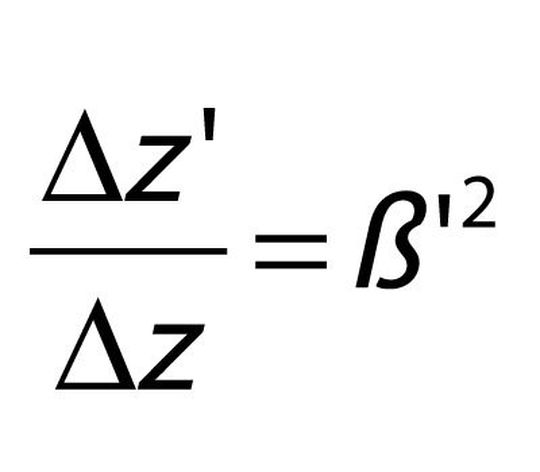

Diese Graphen werden meist für die Abbildungsebene ausgegeben. Mit Hilfe der Werte der lateralen Vergößerung β’ kann einer Raumfrequenz in der Abbildungsebene eine entsprechende Raumfrequenz in der Objektebene zugeordnet werden. Für kleine Werte der bildseitigen Defokusierung Δz’ kann ein Bereich zulässiger Defokusierung in der Objektebene zugeordnet werden, wobei dann gilt folgende Approximationsformel:

Beispiel: Angenommen sei eine obige Through-Focus MTF für ein System mit Vergrößerung β’ = -0,5 und eine Raumfrequenz von 30 lp/mm. Daraus ergibt sich in der Objektebene eine gesehene Raumfrequenz von 15 lp/mm (bedingt durch die Vergrößerung) und, bei Annahme einer zulässigen Mindestmodulation von 30%, dann folgt daraus eine zulässige bildseitige Defokusierung um Δz’ von –0,055 bis 0,057 mm.

Objektseitig entspricht dies den entsprechenden Δz-Werten von –0,220 bis 0,228. Damit haben wir einen zulässigen Schärfetiefenbereich von 0,448 mm. Somit wäre mit diesem System ein Objekt darstellbar, dessen longitudinale Strukturen eine bis zu einer Gesamthöhe von 0,45 mm noch mit entsprechendem Kontrast aufgelöst werden.

Automatisierte Verfahren zur Wahl geeigneter optischer Systeme

In jüngerer Zeit werden von mehreren Seiten Lösungsansätze zur automatisierten Auswahl und Bestimmung geeigneter optischer Systeme unter Verwendung von Software-Lösungen vorgestellt. Solche Ansätze können in vielen Fällen den Anwendungsentwickler bei der Vorauswahl von Komponenten unterstützen, aber es ist warnend anzumerken, dass solche Lösungsansätze zumindest bisher nicht den Erfahrungsschatz der entsprechenden Optik-Spezialisten kompensieren können. Aus diesem Grunde sollte es, nach ersten Grundüberlegungen zur Bestimmung einer geeigneten optischen Lösung, immer das Bestreben eines Applikationsentwicklers sein, frühzeitig die entsprechenden Spezialisten für Optik in ein Projekt zu involvieren, um somit sicherzustellen, dass das Resultat wirklich eine technisch sinnvolle und in Bezug auf Kosten und Leistung optimierte Lösung darstellt.

Ein Beispiel für sinnvolle Hilfsprogramme, die z.B. eine einfache Abschätzungen der optischen Grundparameter wie der Brennweite f’ erlauben, ist die von der Firma Schneider-Kreuznach angebotene GaussOpt-Software.

Qualität des Objektivs: An dieser Stelle sei, neben der durch geometrische Randbedingungen vorgegebenen optischen Parameter, nochmals darauf hingewiesen, dass die Spezifikation dieser Werte alleine letztlich nicht die Güte und Eignung eines Objektivs bestimmt.

Erst durch das jeweilige, z.T. in Jahrzehnten erworbene, spezifische Wissen der verschiedenen Optikhersteller bezüglich Design und Fertigung können Objektive letztlich derart optimiert werden, dass die in der Gänze niemals komplett zu vermeidende Abbildungsfehler auf ein definiertes Minimum reduziert werden und das optische System die letztlich geforderte Leistung liefert. Ohne auf Details eingehen zu wollen, sei dabei sowohl auf die geometrischen Aberrationen (sphärische Aberration, Koma, Astigmatismus, Bildfeldwölbung und Verzeichnung), als auch auf die durch Dispersion der verwendeten Gläser resultierende chromatischen Variationen der oben genannten Fehler verwiesen, die die Eignung eines Objektivs beeinflussen und die in entsprechender Fachliteratur ausführlich erläutert werden. Alleine an diesen die Abbildungsleistung jeweils in spezifischer Art beeinflussenden Artefakten wird ersichtlich, dass selbst bei identischen optischen Grunddaten die optische Leistung und Güte von Objektiven verschiedener Hersteller durchaus deutlich abweichen kann und somit bei der Entscheidung über Eignung oder Nichteignung für eine Applikation herangezogen werden muss.

Ferner sei daran erinnert, dass über die reine optische Leistung hinaus mechanische und klimatechnische Anforderungen an die Applikation – als Beispiel sei hier z.B. die geforderte mechanische Stabilität des Aufbaus genannt, die mit Objektiven in Kunststoffgehäusen langfristig kaum zu gewährleisten ist (z.B. im Rahmen einer Crash-Test-Anlage oder beim Einsatz an beweglichen Teilen wie Roboterarmen) – durch Spezifizierung der optischen Eigenschaften eines Objektivs alleine in keiner Weise reflektiert werden.

Darin und dem je nach Hersteller unterschiedlichen Aufwand in Entwicklung und Herstellung liegt letztlich auch die Ursache einer sehr großen preislichen Spannbreite vieler, von den grundsätzlichen optischen Größen zunächst scheinbar annähernd identischer Systeme begründet.

*Jürgen Kreis ist Leiter der Business Unit Industrieoptik und Witold Hackemer ist Optik-Designer bei Schneider-Kreuznach, Bad Kreuznach.

(ID:181753)

:quality(80)/p7i.vogel.de/wcms/d5/09/d5091cd9a582aa0f780740ec4faac973/0130381601v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/b6/f5/b6f57042111d87f229188016760aa9be/0130112613v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/02/ba/02baa569447a740c8090977765087852/0129990653v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1f/4e/1f4eb9b8068cd0205a3d8975c49e5e8a/0129856192v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/e8/f1/e8f14c0fdc8594771793483749cc9b8e/0131052730v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d6/2d/d62d2bd10f84154e55c1f1a2e4ea98bf/0131046828v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ef/e8/efe83f047b6715c42cc3f5c1e40a7d22/0128634704v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/09/4d/094d608587e31feef7541fb720352804/0131259634v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d5/49/d549930893182b7eb25d934949bf87b5/0131180774v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/57/27/5727526c87106b2d1f5997ebb6923aeb/0131151485v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/c4/d9c4fb35bd609a0ad846625fda5d8217/0130992915v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/2d/a2/2da257cd03db481f1036fa85b76f0bd6/0131184818v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/b0/d7/b0d7762c6e69352f580adfd97400387a/0131178627v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/2d/822d88c9223fd360af1efc97aa3b826f/-22a8000-b-web-20-281-29-800x450v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f0/7c/f07c26fff769926346135a25291af235/synapticon-20humanoid-20rot-3840x2159v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/43/f343fdcfa3c09d38cc9470479bc04e5b/middex-sc8-motoransteuerung-1770x996v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a5/fa/a5fabdb5e59c0683ddc11a4da8b495b3/0131253926v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/b7/04b76ab3f88faf01d28195e7474359db/0130653541v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c0/22/c02215a6b61ad992a3d7079c14c5bba7/siemens-hmi-profinet-motiv-1-068-pro-geraet-fd-50-proz-4725x2656v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/eb/28eb296e910f7bc775e42825546589ad/german-innovation-award-2026-ceremony-16-1500x843v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/a7/41a79c3bb48e11f4c2ae8b33365bcd2f/engin-akyurt-euro-6771167-8192x4608v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/93/36938d694f48ccd4d1f5f9e401fee836/adobestock-704571920--c2-a9-20gumpapa-20-e2-80-93-20stock-adobe-com-6000x3373v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f7/2e/f72ec1cba42abe5d3b3c2615ff37c2ea/adobestock-1840092295--c2-a9-20infiniteflow-20-e2-80-93-20stock-adobe-com-3840x2158v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/02/f6/02f6897da99cea0f0b5a710bdd2b9e89/0130347249v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/58/63/586379bda19d8f06e6015cecb41a4967/kampagnenbild-1947x1095v1.png)

:quality(80)/p7i.vogel.de/wcms/d1/12/d112dfa6e7df4c7af715a4833483f659/0126977441v1.jpeg)

:quality(80)/images.vogel.de/vogelonline/bdb/1651700/1651739/original.jpg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/76800/76895/65.jpg)

:quality(80)/p7i.vogel.de/wcms/a3/c2/a3c2e4893392e815d1d1a81fe4e0d7a5/0124976328v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/4a/3e/4a3e221e1c8c4cc356ef7200f16cc86d/0127991860v2.jpeg)